AI 换脸是通过深度学习算法(如 GAN 或扩散模型)将源人脸特征迁移至目标视频或照片的技术。其核心逻辑是利用海量数据训练,使机器量化人脸的几何结构与光影分布,从而实现像素级的替换。

到 2026 年 3 月,AI 换脸已从娱乐工具演变为成熟的商业基础设施,渗透进远程办公、数字营销与企业招聘。但随着实时篡改能力的提升,视觉真实性正面临信任危机。

技术演进:从自动编码器到潜空间映射

潜空间映射已取代自动编码器成为实时换脸的主流技术方案。 早期的 DeepFace 依赖自动编码器(Autoencoder),通过将两张脸压缩为相同的特征向量再还原。这种方式处理速度慢,且必须针对特定人物进行大量素材训练,难以通用。

目前主流的实时换脸采用潜空间映射(Latent Space Mapping)。AI 不再是简单的“粘贴”,而是在毫秒级时间内分析源面孔的眼角、鼻翼、嘴角等关键点坐标。随后,扩散模型在潜空间中生成适配当前表情与光影的像素块。在 2026 年的算力支持下,仅需一张高质量静态照片,即可生成实时驱动的假面孔。

企业级实时换脸系统部署指南

构建商业级换脸系统,基于开源框架进行二次开发是目前最稳健的路径。 开发者需要重点关注硬件适配、模型阈值调优以及流处理延迟。

python -c "import insightface; print(insightface.__version__)"/models 文件夹。在 config.yaml 中将 face_detection_threshold 设为 0.6。

VideoCapture 将帧推入队列,由 GPU 并行处理。针对脸部边缘衔接问题,需配置高斯模糊掩码,将 feather_amount(羽化值)设在 15-25 像素。

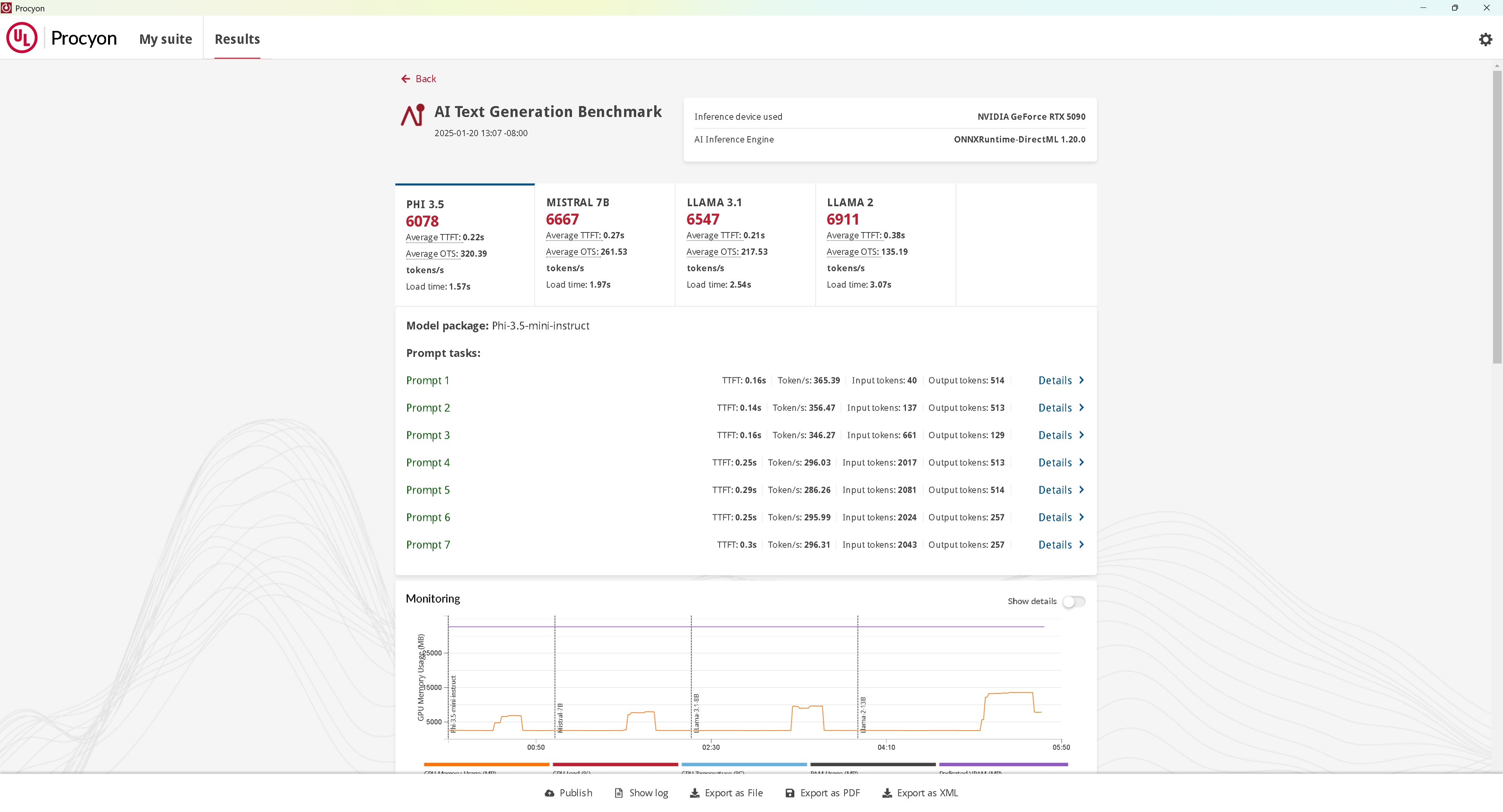

关键配置参数参考表

| 参数项 | 推荐值 | 影响分析 |

|---|---|---|

| face_detection_threshold | 0.6 | 过高导致掉脸,过低导致误识别 |

| feather_amount | 15-25px | 控制边缘融合自然度,防止锯齿 |

| Target Latency | < 100ms | 影响实时交互的同步感 |

商业逻辑:从单点工具到工作流集成

AI 换脸的商业价值正在从“新鲜感”转向“生产力”。 纯娱乐产品的留存率极低,目前的趋势是将换脸功能集成到专业的工作流中,例如将电商模特替换工具化,从而显著降低拍摄成本并提升商业价值。

风险与局限:身份伪造与技术死穴

视觉证据的可靠性在快速下降,导致“视频通话即真实”的心理防御被打破。 2025 年已有案例显示面试者利用实时换脸伪造资深工程师身份。目前技术仍存在三个核心死穴:

- 极端角度: 旋转超过 60 度或被遮挡时,易出现像素拉伸或闪烁。

- 光影冲突: 源图与目标视频色温差异大时,阴影区会出现违和色块。

- 算力门槛: 高质量实时换脸依赖昂贵 GPU,手机端轻量化模型效果较差。

适用场景建议

针对不同信任等级的场景,应采取差异化的技术验证方案。

- 慎用场景: 银行开户、合同签署等高法律效力验证(建议改用虹膜+声纹多模态识别);极度敏感的私人情感沟通;未经授权的商业广告(规避 2026 年后的版权诉讼)。

如何有效识别实时AI换脸?

可以通过要求对方进行“随机动作验证”来识别。例如要求对方快速遮挡脸部、大幅度侧头或随机挥手,目前大多数实时模型在处理突发遮挡或极端侧脸时会出现明显的像素撕裂感或闪烁。

部署时出现画面闪烁如何优化?

画面闪烁通常由人脸检测阈值不稳定或帧间不连续引起。建议在后处理阶段引入平滑滤波算法,并适当调高 face_detection_threshold 以过滤不稳定的候选框。

实时换脸对显存的最低要求是多少?

虽然轻量化模型可在 8GB 显存运行,但若要实现商业级、无明显延迟且高分辨率的实时输出,建议配置 24GB 显存(如 RTX 3090/4090)以确保潜空间映射的推理速度。

执行建议

对于不同角色,应对 AI 换脸技术采取不同的应对策略: